正直言うと、JetsonでこういうVLMがサクッと動くようになるってのは、現場のエンジニアにとって夢の話だ。これまではクラウド頼みだった画像処理が、現場で完結するようになるのは本当にデカい。

── レン

▸何が変わったのか

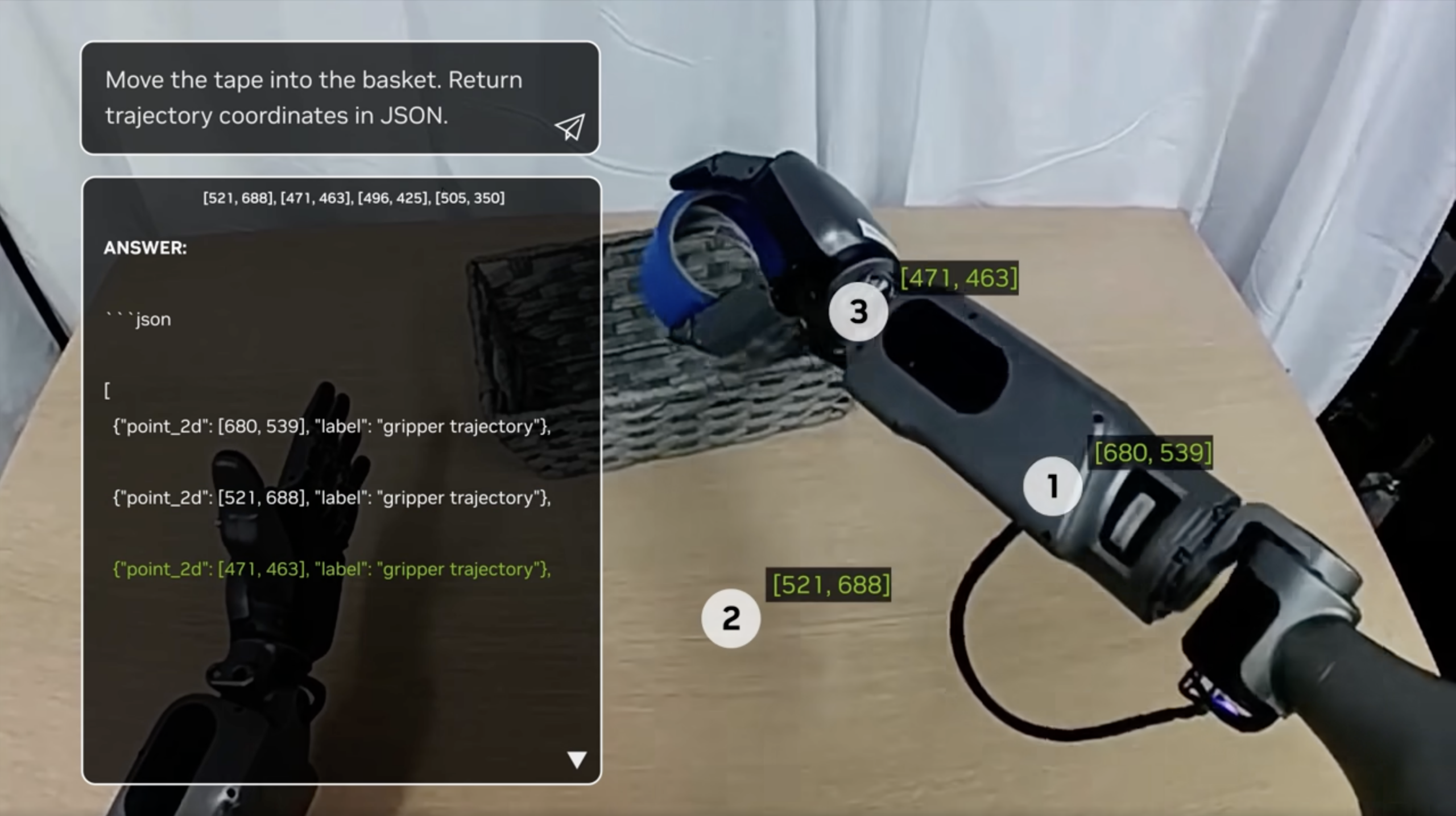

Hugging Faceが、NVIDIA Jetson上でオープンソースのVLM(視覚言語モデル)をデプロイする手法を詳しく紹介。ロボットやドローンといったエッジデバイス単体で、高度な画像理解とテキスト生成を行う環境が整ってきた。これにより、通信ラグやプライバシーの問題を気にせず、現場の端末だけで賢いAIが動かせるようになる。

◈技術背景と意義

VLMは、人間のように画像を見てその状況を言葉で説明できるAIのこと。Jetsonは、手のひらサイズの高性能コンピューターで、ロボットの脳みそとしてよく使われている。この二つを組み合わせることで、インターネットに繋がらない工場や屋外でも、その場の瞬時にAIが「何が起きているか」を理解できるようになるんだ。

SOURCE: Hugging Face (2026-02-26)

コメントを残す