Alibaba (Qwen) が Qwen3.6-35B-A3B をリリース ── 総パラメ35Bでアクティブ3B、驚異的な軽さとコーディング性能

Qwen3.5のリリースから間もなく、まさかの「Qwen3.6」がいきなりHugging Faceに降ってきた。しかも総パラメータ35Bに対して、実際に動くのはたった3Bという超絶技巧なMoEモデルだ。これがコーディングエージェントのベンチマークで大型モデルを凌駕するスコアを出しており、かなりエグい。

▸何が変わったのか

最大の衝撃は、256人のエキスパートのうち8つのルーティング+1つの共有エキスパートのみを活性化させるというMoE(専門家混合)の極致みたいな設計だ。そのくせ、ネイティブで262,144、最大1,010,000トークンという超長文脈に対応している。コーディングエージェント機能が強化され、フロントエンドのワークフローやリポジトリ単位の推論が流暢にこなせるほか、過去のメッセージから推論コンテキストを保持する「Thinking Preservation」という新機能も導入された。

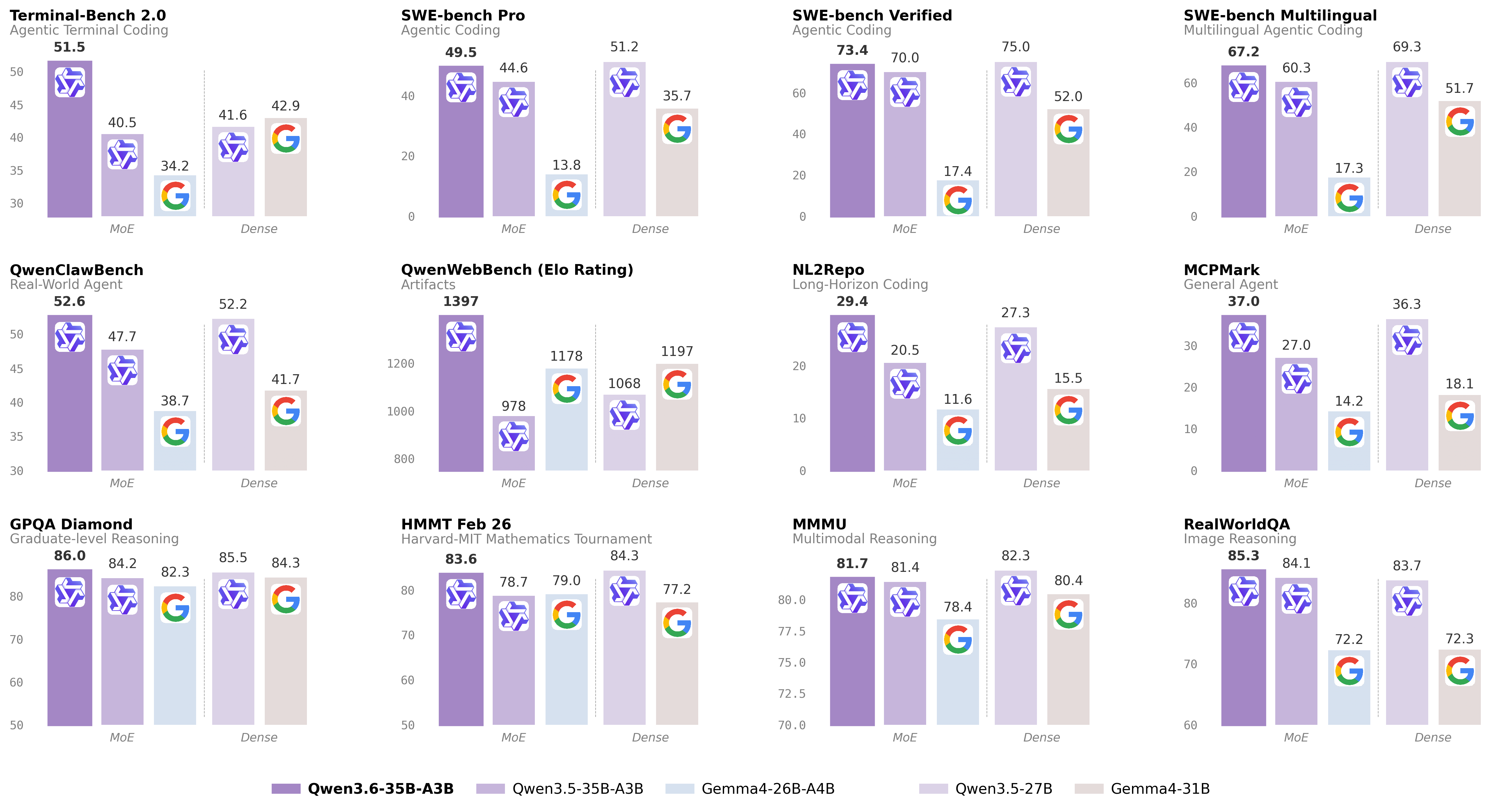

◈前モデル / 競合との比較

SWE-bench Verifiedで73.4、Terminal-Bench 2.0で51.5を記録し、Gemma4-31Bなどの競合を大きく突き放している。特にツール利用を測るMCPMarkでは37.0を叩き出し、前バージョンのQwen3.5-35BA3B(27.0)から大幅な進化を遂げた。

◈技術背景と意義

MoEは、タスクに応じてAIの頭脳の一部(専門家)だけをスイッチングして使う省エネ技術。今回はGated DeltaNetとGated Attentionをハイブリッドで組み込む最新アーキテクチャを採用している。パラメータ効率が異常に高いため、ローカル環境でもハイスペックマシンがあれば動かせる可能性がある。

▸こんな人・用途に

コーディング特化で反復開発もしやすい設計のため、自律型コーディングエージェントとしての実用性が高い。超長文脈を活かした大規模リポジトリの丸ごと解析や、コストを抑えつつ高度な推論が必要な開発タスクにうってつけだ。

▸Redditの反応

「性能劣化なし」を謳う uncensored モデルの登場に、コメント欄は懐疑的な空気になってる。リリースを歓迎する声はあるものの、これまでの経験から検閲解除による能力低下を疑う声が少なくないね。

「リリース作業ありがとう!ちょっと気になったんだけど、今ダウンロードできる量子化ファイルが2つしかないんだよね。たぶんまだアップロード中ってことかな?」

「性能劣化なしってマジで?ちょっと信じがたいな。これまで性能が落ちない uncensored モデルなんて見たことがないんだよね。」

「どうやってファインチューニングしたのか、「能力低下ゼロ」を具体的にどうテストしたのかなど、肝心な情報がまだ圧倒的に足りない気がする。」

◆入手方法・リンク

Hugging Faceでオープンウェイトとして公開されており、誰でもダウンロード可能。vLLMやSGLang、KTransformersなど主要な推論エンジンですぐに動かせる。

SOURCE: Alibaba (Qwen) (2026-04-15)