Hugging Face が Deploying Open Source Vision Language Models (VLM) on Jetson をリリース ── ロボットの「目」が進化する瞬間

エッジデバイスでここまでのAIが動くようになると、やはりロボットの未来が楽しくなってきます。クラウドに頼らず、その場で画像を理解して判断できるというのは、現場のニーズに凄くマッチしていますよね。

── レン

▸何が変わったのか

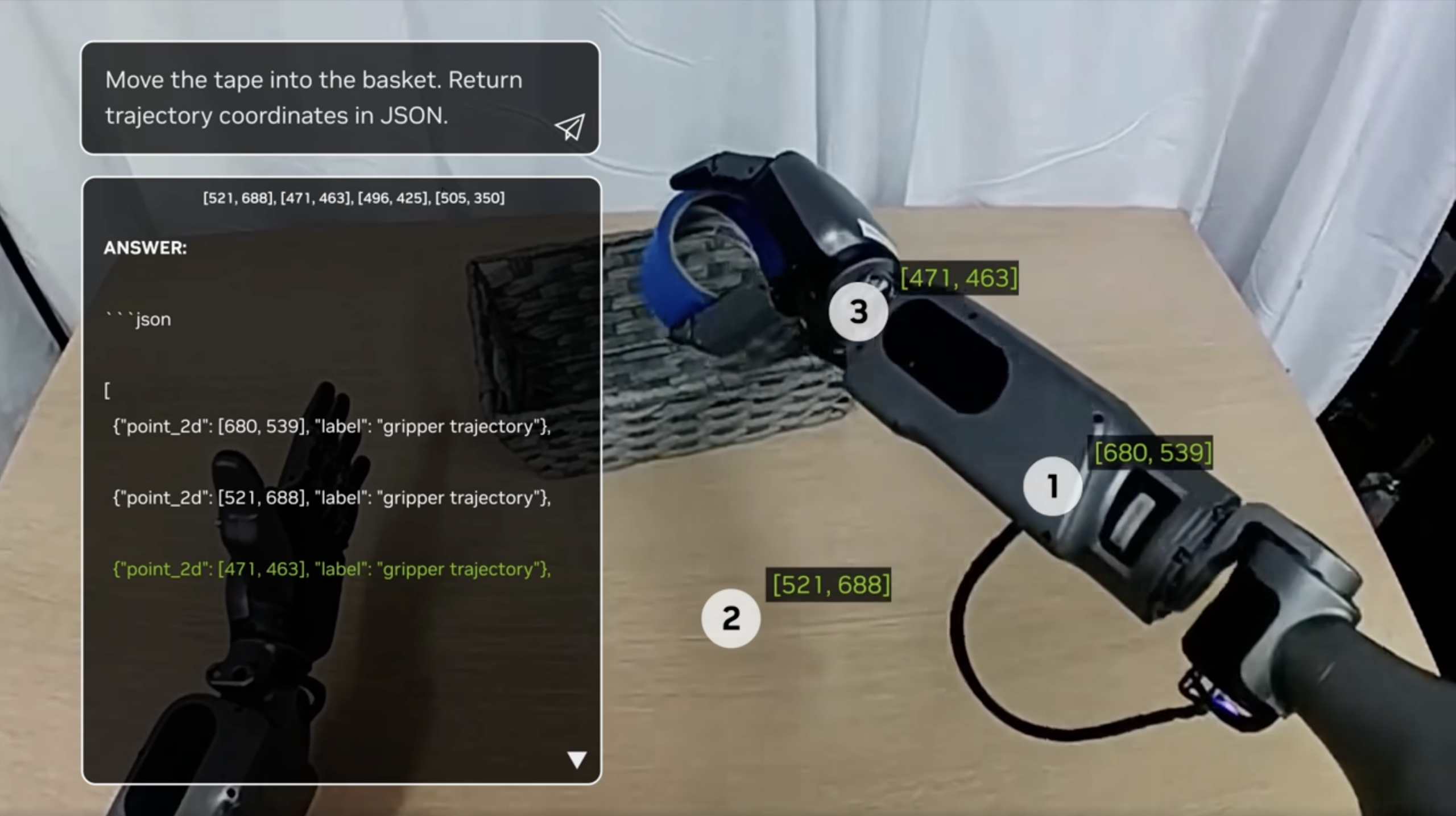

Hugging FaceがNVIDIA Jetsonプラットフォーム上で、オープンソースのVLMをデプロイする手法を確立しました。LLaVAなどを代表とするモデルを、エッジ側で効率的に動作させる環境が整ったのがポイント。これにより、ネットワーク接続が制限される環境でも、高度なビジョンタスクを実行可能。ロボットやドローンの自律性を高めるインフラとして、かなり実用的です。

◈技術背景と意義

画像と自然言語を同時に扱える「VLM」ですが、動かすにはそれなりの計算パワーが必要で、これまではサーバー室での運用が基本でした。Jetsonはロボットの頭脳に搭載される小さなスーパーコンピュータのようなもので、これを活用することで機械自身が「目」で見て「頭」で考える処理を現場で完結できます。モバイルバッテリーでも動くような省電力と高性能の両立が、この技術の肝と言えます。

◆入手方法・リンク

具体的な導入手順や最適化のノウハウは、Hugging Faceの公式ブログや関連ドキュメントページから確認できます。Jetsonデバイスをお持ちのエンジニアは、ぜひ一度試してみるといいかもしれません。

SOURCE: Hugging Face (2026-02-27)