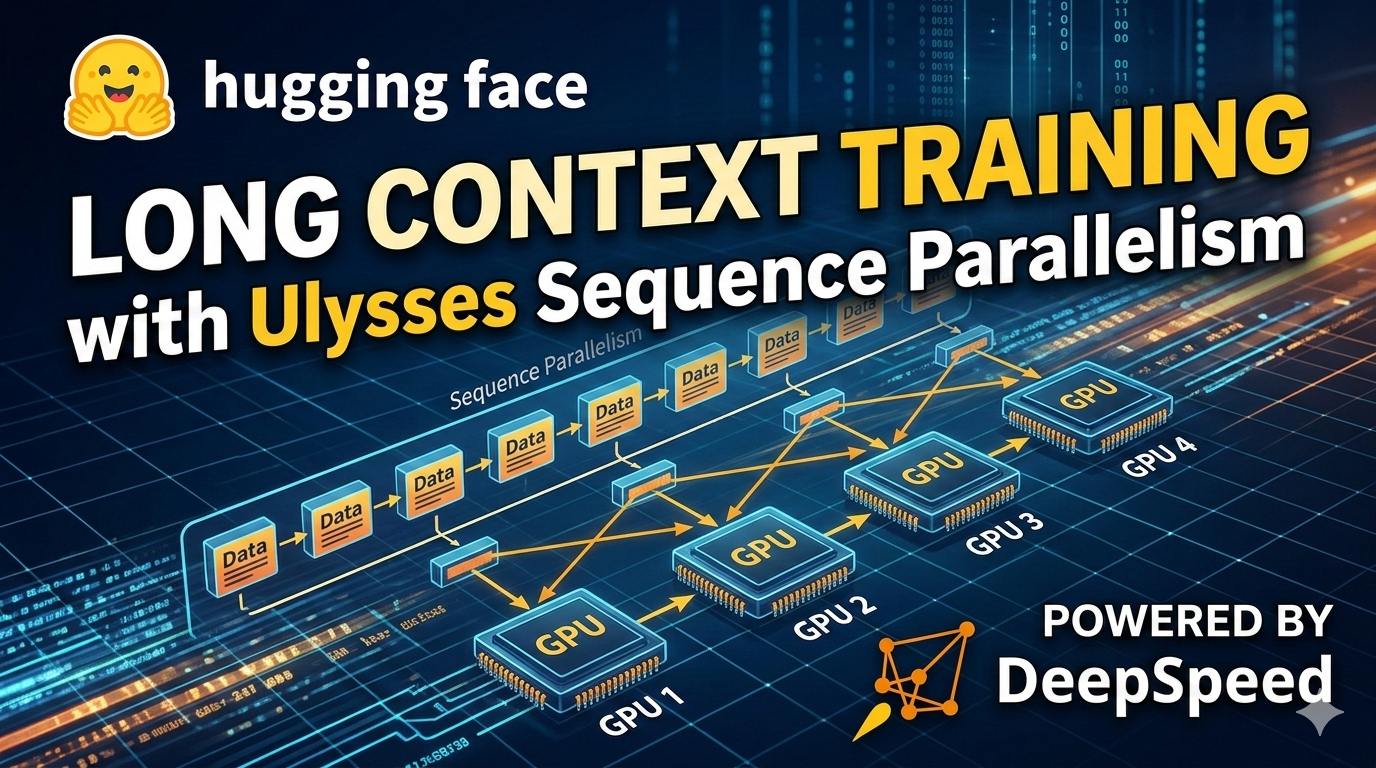

Hugging Face が Ulysses Sequence Parallelism: Training with Million-Token Contexts をリリース ── 100万トークン級の文脈学習を可能に

ついに「100万トークン」という途方もない長さの文脈を扱うモデル学習が現実味を帯びてきた。Hugging Faceが紹介する「Ulysses Sequence Parallelism」は、GPUのメモリ限界をスマートに回避しつつ、これまで困難だった超長シークエンスの訓練を可能にする技術だ。これがあれば、まるで長編小説を丸ごと飲み込むようなAIのトレーニングも、もはや夢物語ではなくなるかもしれない。

▸何が変わったのか

今回の焦点は、Snowflake AI Researchによる「Arctic Long Sequence Training (ALST) プロトコル」の一部である「Ulysses Sequence Parallelism」だ。この技術は、アテンションヘッド並列化を通じてアテンション計算を複数のGPUに分散させ、これまで単一GPUでは処理できなかった長さのシークエンス学習を可能にしている。平均的な本1冊分にあたる「約25万トークン」を超えるようなマルチドキュメント文脈や、本の長さに相当する入力もメモリ不足に陥ることなく扱えるようになったのが大きなポイントだ。すでにHugging Face Accelerate、Transformers Trainer、TRLのSFTTrainerといったエコシステムにも統合されており、開発者はすぐにこの恩恵を受けられるようになっている。

◈前モデル / 競合との比較

従来のデータ並列化では各GPUが全シークエンスを保持する必要があったが、Ulyssesはこれを分散させるためメモリ効率が劇的に異なる。また、メモリ使用量をO(n)に抑えるFlashAttentionに対し、Ulyssesは計算量O(n^2)というボトルネックを分散計算によって解決しようとする点でも優れている。記事内では、同様の長文脈処理を目指す「Ring Attention」との比較についても言及されている。

◈技術背景と意義

現在のAIモデルで主流のTransformerには、処理する長さが増えると計算量とメモリが飛躍的に増える(二次関数的に増える)という課題があった。従来の「データ並列化」では、各GPUがシークエンス全体を処理しなければならなかったため、どうしてもメモリ不足が起きてしまう。そこでUlyssesは、シークエンスそのものを複数のデバイスに分割して処理するというアプローチをとっている。これにより、FlashAttentionのような最適化技術と組み合わせながら、従来は諦めていた超長文の学習を効率的に実行できるようになったわけだ。

▸こんな人・用途に

・文書全体の分析:法律文書や研究論文、あるいは本1冊丸ごとといった膨大なテキストを一つのコンテキストとして処理したい場合

・大規模コードベースの解析:複数のファイルが複雑に絡み合うソースコードを、全体像を維持したまま理解・解析したい開発者向け

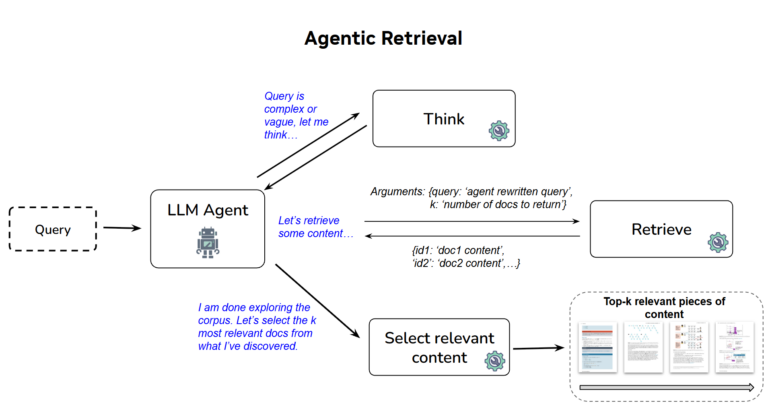

・高度な推論タスク:検索拡張生成(RAG)で大量の参照文献をコンテキストに詰め込んだり、モデルが長い思考チェーンを必要とするタスク

◆入手方法・リンク

具体的なGitHubリポジトリ情報は現時点では提供されていないが、Hugging Faceの主要なライブラリであるAccelerate、Transformers Trainer、およびTRLのSFTTrainerにはすでに統合されているため、これらを通じて機能を利用できる。詳細な実装方法やベンチマークについては、Hugging Faceの公式記事「Ulysses Sequence Parallelism: Training with Million-Token Contexts」を参照してほしい。

SOURCE: Hugging Face (2026-03-09)