Hugging Face が Falcon Perception をリリース ── 画像と言語を1つのTransformerで処理する新アーキテクチャ

画像とテキストを別々に処理してから無理やりくっつける、そんな複雑なパイプラインに思わず見直す時間が来たかもしれない。0.6Bパラメータというコンパクトな体躯でありながら、最初から視覚と言語を1つのシーケンスとして同時に捌く「Falcon Perception」のアプローチがなかなか面白い。

▸何が変わったのか

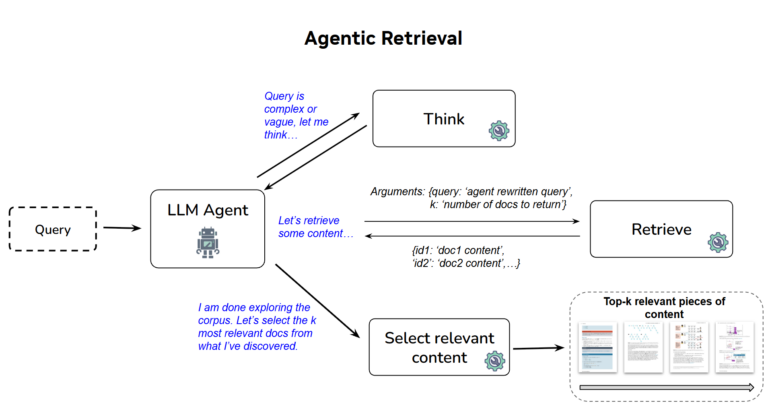

従来の画像認識システムは、視覚用モデルと言語用モデルを分けて後から組み合わせるパイプライン方式が主流だった。しかしFalcon Perceptionは、画像パッチとテキストを最初の層から共有パラメータ空間で処理する単一の早期融合Transformerを採用。オブジェクトのプロパティを `

◈前モデル / 競合との比較

SA-Coベンチマークにおいて、Falcon Perceptionは68.0 Macro-F1を記録し、SAM 3の62.3を大きく上回った。ただし、presence calibration(MCC)のスコアはSAM 3の0.82に対して0.64と、まだ改善の余地が残っている。一方、同時リリースされたFalcon OCRは、olmOCRベンチマークで80.3、OmniDocBenchで88.6を記録し、オープンソースのOCRモデルの中で最高のスループットを叩き出している。

◈技術背景と意義

画像の中から「左側の赤いコップ」みたいな感じで特定のモノを言葉の指示で見つけ出すタスクは、これまで複数の専用AIパーツを繋ぎ合わせて実現することが多かった。でもこのモデルは、画像の情報とテキストの情報を最初から同じ「脳」内で同時に処理する仕組み(早期融合)を採用している。これによってシステム全体がシンプルになり、どこをどう改善すればいいのかも分かりやすくなるというわけだ。

▸こんな人・用途に

・自然言語のプロンプトから画像内の特定オブジェクトを高精度に切り出したいケース

・属性や空間的な制約、関係性など、細かな条件を指定しての画像分析

・高い処理スループットが求められる大規模なドキュメント解析(Falcon OCR)

▸Redditの反応

投稿自体はそこまでバズっていないものの、地味に実務での活用を期待する声や、重いサンプル画像へのツッコミなど、率直な反応が散見される。

「QGISでのセグメンテーション用途にかなり面白そう。少し前に古いオルソ写真を使って樹木のセグメンテーションを試したけど、あれは精度が足りなくてデータとして使い物にならなかったんだよね。」

「HuggingFaceのブログにある7.5MBの鳥の画像、マジで重いよ。みんながカリフォルニアに住んでて10Gbpsの光回線を使ってるわけじゃないんだから。」

「GLM-OCRとの比較がないのはちょっと残念。競合モデルとのしっかりしたベンチマークが見たいところ。」

SOURCE: Hugging Face (2026-04-01)