Google DeepMind が Gemini Robotics-ER 1.6 をリリース ── 自律的ロボティクスのため空間推論能力を強化

ついにGeminiが現実世界のロボットを動かす時代が本格化してきた。Google DeepMindが物理的なタスクをこなすロボット向けモデル「Gemini Robotics-ER 1.6」を発表した。AIが画面の中だけでなく、現実の空間を認識して動き回る未来が一気に近づいていてワクワクする。

▸何が変わったのか

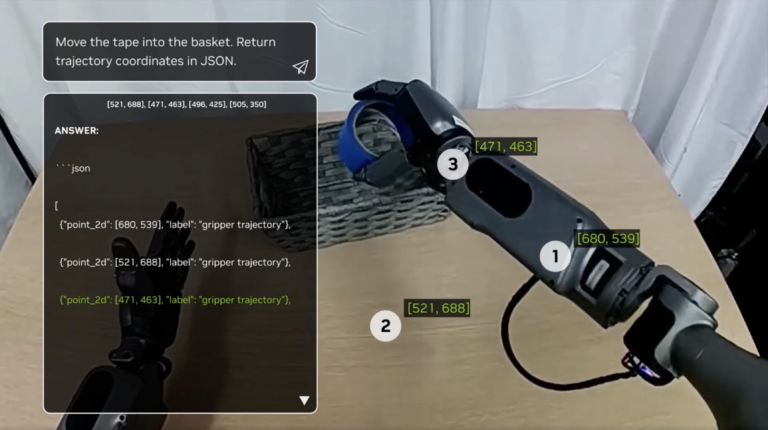

今回の最大のアップデートポイントは「spatial reasoning(空間推論)」と「multi-view understanding(多視点理解)」の強化。自律型ロボットが周囲の環境をどう認識し、どう動くべきかをより正確に判断できるようになった。複数のカメラやセンサーから入ってくる異なる視点の情報を統合し、3D空間を正確に把握する能力が向上している。これにより、複雑な現実世界のタスクをこなす際の精度が大きく跳ね上がるはずだ。

◈技術背景と意義

従来のAIは画像を見て「それが何か」を認識するのは得意だったけど、現実の空間を移動するロボットにはそれだけでは不十分。立体的な距離感や奥行き、いろんな角度からの見え方を統合して「今自分がどこにいて、どこに何があるか」を理解する必要がある。今回のモデルの根幹である「embodied reasoning(具現化推論)」は、まさにAIが物理的な体を持って現実世界と相互作用するための頭脳を指している。

▸こんな人・用途に

複雑な倉庫内での自律的ピッキングや搬送を行う物流ロボットの開発。人間が入り込めない危険な環境下での探索や作業を自動化したい研究機関。

▸Redditの反応

スコアこそいくつか付いているものの、コメントはまだ寄せられていない静かな状態。新しい技術への関心はあるものの、議論にまでは至っていない様子。

SOURCE: Google DeepMind (2026-04-13)